こんにちは、中のひとアツです。

ブログ記事の構成を練っているときに、GeminiやChatGPTの利用制限に引っかかって作業が強制ストップ……。「あーもう!一番いいところだったのに!」と頭を抱えて、執筆のモチベーションが完全に途切れてしまった経験はありませんか?

クラウド型AIの「制限の壁」という強烈なストレスから解放されるべく、ガジェット好きの物欲に火がつき、「メモリを32GB積んだM4搭載Mac mini」を勢いでポチってしまった私。

本記事は、ITリテラシーにはある程度自信があるものの「ローカルLLMに関しては全くのド素人」の私が、話題の沼へ飛び込み、最終的には外出先のiPhoneから自宅のAIにアクセスする(という構想を描く)までのリアルな顚末をお届けする連載シリーズの第1回です。

今回は、自作PC沼からの脱出劇から、ChatGPTとの壁打ちで決めたスペック選びの裏話までを赤裸々にお届けします。これからローカルLLMの導入を検討している方、必見です!

そもそも「ローカルLLM」って何?魔法の環境になる……といいな!

「最近よく聞くローカルLLMって、普通のChatGPTと何が違うの?」と疑問に思う方も多いですよね。安心してください、私もローカルLLMに関しては全くのド素人です!

私たちが普段使っているクラウド型AIサービスはとても賢い反面、どうしても避けられないデメリットが存在します。

- すぐに利用制限に引っかかる「利用回数の上限」

- 毎月発生する「サブスク課金」

- 無料版だと設定次第で入力したデータが学習に使われてしまう「セキュリティリスク」

(※私はGoogle Workspace版のGeminiをメインで使っているので、ここはしっかり抑えられていますが!)

すでに月額課金をしているのに自分のペースで作業ができず、かといって上限を気にしなくて済むさらに上のプランへアップグレードするとなると、とても個人が気軽に払える金額ではありません。

ここで、私の中の「物欲の悪魔」が囁きました。

「ねえ、その上位プランを半年契約するくらいのお金で、Mac mini本体が買えちゃうんじゃない……?」

そこで救世主となる(らしい)のが「ローカルLLM」です。インターネット上のサーバーを経由せず、自分のパソコン上で直接AIモデルを動かす技術のことを指します。

- 完全に無料(機材、電気代のみ)で24時間365日使い放題!

- どれだけチャットラリーをしても「制限の壁」が一切ない!

- オフラインでも動き、情報漏洩のリスクがゼロ!

まさに、自分専用の優秀なアシスタントを自分のデスクに常駐させるようなもの……になるはずです。本当にそんな「魔法の環境」になるのかは実際に作ってみないと分かりませんが、「そんなふうになれば最高だな!」と大きな希望を抱いています。

結局のところ、私がこの構成でMac miniをポチった最大の理由は、以下の3つを完璧に満たしてくれる最高の自己投資(という名の言い訳)だったからです。

- 実用性: ブログ記事の構成相談はもちろん、「ラジコンのLEDをPICマイコンでプログラミングして動かすには?」といった、ネットで調べても答えが出ず、身近な人にはマニアックすぎて引かれてしまうニッチな趣味の壁打ち相手になってほしい!(という強い希望)

- 知識欲: 最近やたらと界隈で流行っている「ローカルLLM」を、自分もちょっとかじってみたい!

- 物欲: 単純に、新しくてパワフルな最新デバイスを買ってテンションを爆上げしたい!

なぜWindowsではなく「Mac mini」?自作PC沼からの脱出劇

「よし、ローカルLLMをやるぞ!」と決意したものの、AIを動かすマシンのOSを選ぶ際、「超高性能なグラフィックボード(GPU)を積んだWindows PC一択」と思われがちです。

しかし、私はあえてWindowsを選ばず、迷うことなく「Mac mini」を選択しました。 それには、私の過去の「恐ろしいトラウマ」が関係しています。

実は私、何なら「486(i486プロセッサ)」の時代から、ゴリゴリのWindows自作PC派でした。 しかし、自作PCには恐ろしい魔物が棲んでいます。

「もっと処理を速くしたい」と次から次へと新しいパーツを買い足してしまう、終わることのない「パーツ交換の沼」にズブズブと沈んでしまったのです。

気付けばもう一台PCを組めるようになることも日常茶飯事です。

その底なし沼から必死に抜け出すために私がとった最終手段。それが、「物理的にパーツを交換する余地のないMacへ移行する」ということでした。

もしここでローカルLLMのためにWindows環境へ戻ってしまえば、今度こそ「数十万円もする超高額な最新GPUを毎年買い替える」という、さらに深い地獄の沼に引きずり込まれることは目に見えています。

だからこそ、Windowsで高額なGPU単体を購入する予算をはるかに下回る価格で本体丸ごと買えてしまい、Apple独自の「Metal対応」でAI処理も爆速になるという「Mac mini」は、私にとって絶対に選ぶべき救世主だったのです。

ローカルLLMに最適なMac miniのスペックは?AIと決めた構成

恐怖のGPU沼を回避し、「Mac miniを買う!」と決断した私でしたが、パソコンのスペック選びは初心者にとって最初の難関です。絶対に失敗したくないという思いから、まずはChatGPTを壁打ち相手に指名し、ローカルLLMを動かすための最適な構成を相談してみました。

そこから導き出された、ガジェット好きならではの「攻めたスペック選び」の全貌を解説します!

前提条件

- ブログの案を練るのに幾度もラリーをする前提なので、ラリーに耐えるスピードを確保したい

- ブログの過去記事を参照する可能性がある

- 実験を兼ねているので最新モデルを使っていきたい 将来的にはAIエージェントも視野

- Mac miniはローカルLLM専用機で他のPCやスマホからもアクセスして使いたい

- UIはGUIでチャット形式で使用したい

- 構築者はローカルLLMに関しては素人、専門用語は解説を入れて

必須の「ユニファイドメモリ」と32GBの選択

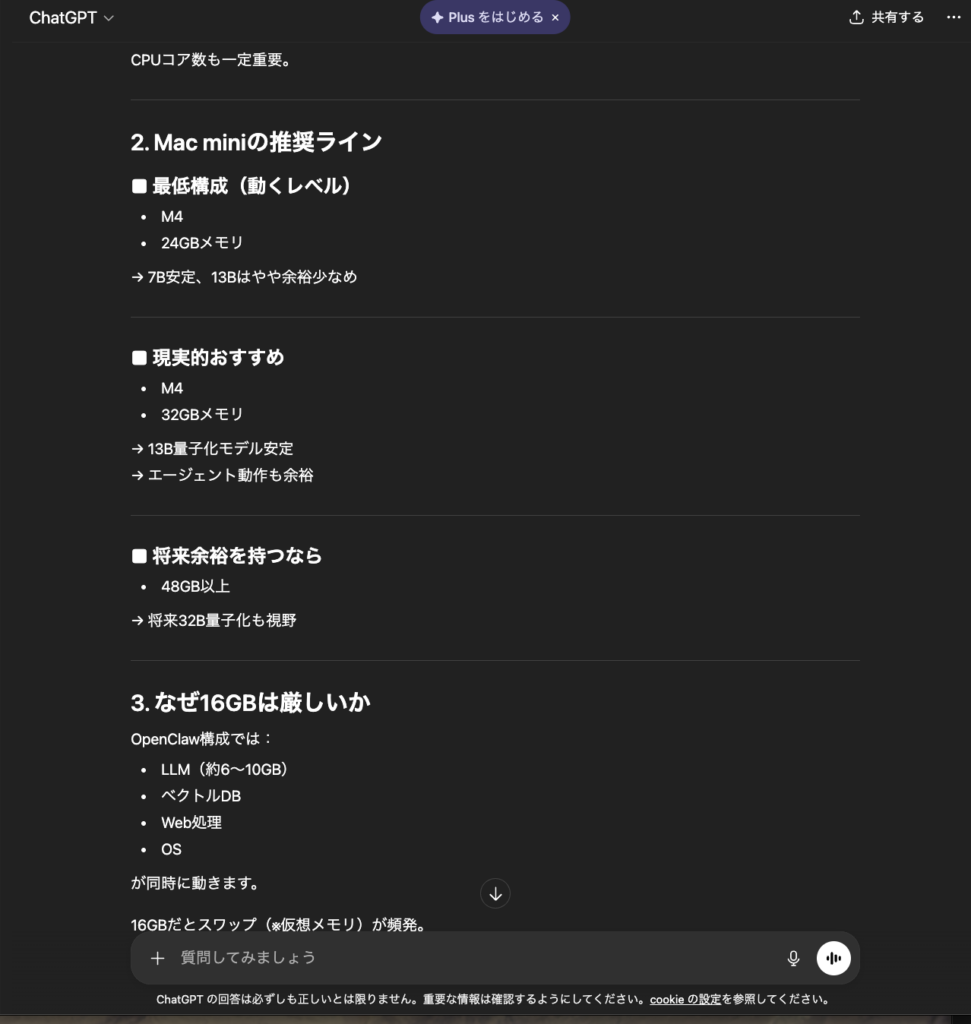

ローカルLLMを快適に動作させる上で最も重要視すべきパーツは、CPUの処理速度ではなく、ずばり「メモリ(RAM)の容量」です。

Windows PCでAIモデルを動かすためにはグラフィックボードに搭載されているビデオメモリ(VRAM)が大量に必要となります。しかし、Apple Silicon(Mチップ)を搭載したMacシリーズは全く構造が異なります。

Macに採用されている「ユニファイドメモリ」は、CPUとGPUでメモリの領域を共有する無駄のない設計になっています。つまり、搭載しているシステムメモリの大半を、そのままそっくりVRAMとしてAI処理に割り当てることが可能なのです。

ChatGPTへ相談した際にも、非常に明確な答えが返ってきました。 「ローカルLLMをやるなら、とにかくメモリだけは最大限積んでおけ」

そこで私は最新の「M4チップ」搭載モデルを選択し、ベースチップでカスタマイズ可能な最大容量である「32GB」のメモリを選びました。もちろん上を見ればキリがありませんが、現実的な導入コストと「個人が自宅で運用する」というバランスを考えたとき、この32GBが最も理にかなったベストな選択だと判断したのです。

容量不足は後回し!あえて512GBにした楽観的理由

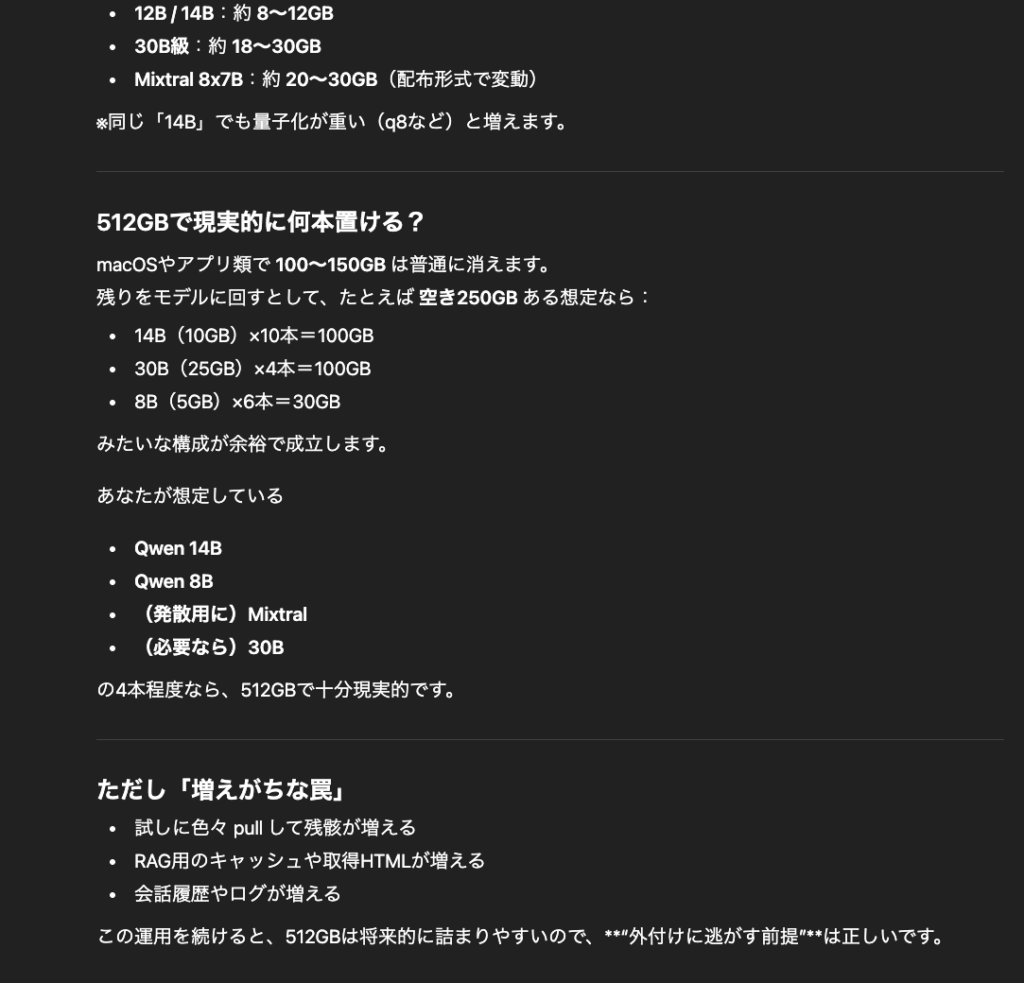

メモリを最大の32GBに決定したのち、次の課題はストレージ(SSD)の容量選びでした。ここで再びChatGPTに相談したところ、非常に現実的で的確なアドバイスが返ってきました。

「AIモデルのデータは非常にファイルサイズが大きいため、最低容量の256GBは絶対に避けるべき。理想を言えば1TBを推奨します」

ご存知の通り、Apple公式ストアでのストレージ増設オプションは非常に高額です。どうしようか迷っていると、AIはさらに賢い「逃げ道」を提案してくれました。

「最初から無理をして1TBにする必要はありません。まずは512GBでスタートし、将来的にモデルをダウンロードしすぎて容量が足りなくなったら、その時にThunderbolt対応の高速な外付けSSDを買い足して、そちらにモデルデータを移して運用すれば全く問題ありませんよ」

このアドバイスを聞いて、私のガジェット好きとしての直感と、特有の「ポジティブな楽観視」が全開になりました。

「よし、AIの言う通り最低容量を回避して、一つ上の512GBにしておこう!最悪、後から外付けSSDにデータを逃がせばいけるし、最近のMac miniは自力でSSDの換装もできるらしいから何とかなるでしょ!」

「パーツ交換の沼から逃げるためにMacにした」と豪語していたにもかかわらず、最新のMac miniがモジュール式SSDを採用していると知った瞬間、「いざとなれば換装できるらしい」というロマンに惹かれつつ、しっかりと「後から外付けSSDを買う」という逃げ道も用意しているこの都合の良さ。

でも実は、この「まずは512GBで始めて、後からThunderbolt外付けSSDに頼る」という運用は、初期投資の高額なApple純正ストレージを避けてローカルLLM環境を安価に構築するための、AIも認めた最高に賢い選択肢なのです。

【圧倒的メリット】電気代で元が取れる!?Mac miniの異常な省電力性

スペックと容量に加えて、私がMac miniを激推しする「隠れた最大の理由」がもう一つあります。それは、WindowsのハイエンドPCとは比較にならないほどの「異常な省電力性」です。

ローカルLLMは、AIに文章を生成(推論)させている間、PCのパーツに極めて高い負荷をかけます。もし同等レベルのAI処理をWindowsデスクトップPC(RTX 4070等の高性能GPU搭載機)で行おうとした場合、消費電力には以下のような絶望的な差が生まれます。

| 稼働状況 | Mac mini (M4 / 32GB) | Windows PC (RTX 4070級搭載) |

| 待機時(アイドル) | 約 4〜6 W | 約 60〜100 W |

| AI処理時(高負荷) | 約 40〜65 W | 約 300〜450 W 以上 |

| 特徴・排熱 | スマホ充電器レベル。ほぼ無音で熱も持たない。 | 小型の暖房器具レベル。ファンの騒音も大きい。 |

いかがでしょうか。Mac miniはフルパワーでAIを動かしていても「最大で約65W程度」しか電力を消費しません。これは一般的なWindows PCが「何もせずにただ起動しているだけ(待機時)」の電力よりも低い数値です。

将来的にローカルLLMを「自分専用の常駐アシスタント」として24時間いつでもアクセスできる状態にしておきたいと考えたとき、Windows PCの電源を入れっぱなしにすれば毎月の電気代は跳ね上がります。しかしMac miniであれば、待機時はわずか5W前後。1ヶ月つけっぱなしでも電気代はジュース1本分程度に収まります。

つまり、長く使えば使うほど電気代で元が取れてしまう、究極のエコシステムなのです。

まとめ:到着まで3週間!爆売れMac miniを今すぐポチろう

制限ゼロのAI環境に夢を見て、ChatGPTの的確なアドバイスのもと、ついに理想のMac mini(M4/32GB/512GB)をポチった私。

もしあなたが今、この記事を読んでローカルLLMの導入を検討しているのなら、ここで一つだけ重大な注意点をお伝えしておきます。

現在、M4チップを搭載したMac miniは、その驚異的なコストパフォーマンスとローカルLLM適性の高さから世界中で記録的な爆売れ状態となっています。 特に、ローカルLLMに必須となる「メモリ32GB」のカスタマイズモデル(CTOモデル)は注文が殺到しており、私の場合も「注文から手元に届くまで3週間程度かかる」という納期の壁に直面しています。

タイミングを逃せば、1ヶ月以上の待ち時間になってしまう可能性も十分にあり得る状況です。「よし、買おう!」と決心したなら、悩んでいる暇はありません。1日でも早くポチって納期待ちの列に並ぶことが、最速でローカルLLM環境を手に入れる唯一の絶対条件です。

「でも、32GBにカスタマイズしたMac miniって結構いいお値段するよね……」と、カート画面でマウスを持つ手が震えてしまった方。 ご安心ください。私も最終的な決済ボタンを押す瞬間の不安に対しては、「まあ、生きていれば何とかなるさ!」という、ガジェット好き特有の限界突破スピリットで潔く乗り切りました。

クラウド型AIの利用制限という日々のストレスを無くし、ニッチな趣味の最強の相棒を手に入れるための自己投資。これは決して無駄遣いではなく、未来の自分の生産性を爆上げするための正当な「物欲の免罪符」なのです。

【次回予告】いざ構築!の前に立ちはだかる「プロンプト」の泥沼

Mac miniが届くまでの3週間。「機材さえ届けばすぐに夢の無制限AI環境が手に入る!」とワクワクしていた私でしたが、いざ事前準備を進めようとした矢先、全く想定外の落とし穴が待っていました。

そもそも、AIに的確な構築手順を教えてもらうための『プロンプト』が書けない……!

次回、【シリーズ第2回:プロンプト泥沼編】では、ChatGPTとGeminiの意見割れによる大混乱から、AIをスパルタメンターに育てるための「プロンプト作成術」までを公開する予定です。

私が実際に使っている「Gems用プロンプト」のコピペ配布もありますので、ぜひ次回の記事も楽しみにお待ちください!

コメント