こんにちは、中のひとアツです。

ついに手元に届くMac mini M4(32GBモデル)。

本当は「次回こそ実機に導入する実践編!」という記事をお届けする予定だったんですが……ハタと気づいてしまいました。

「あれ、私自身は肝心のLLMモデルのこと、なにも検証してないぞ?」と。

連載の第2回でAIに環境構築の構成を考えてもらい、前回の第3回では「Ollamaを捨ててuv+ネイティブ構成にする」という提案が本当に正しいのか、その裏付けを徹底検証しました。

そこで満足しかけていたのですが、よく考えたらその際、AIは「中で動かすLLMモデル」についても、私の用途(ブログの案出しや過去記事の読み込み)に合わせて適切と思われるモデルを提示してくれていたんです。

「側(環境)の検証はしたけど、中身(モデル)の検証をせずに導入するのはマズい! そもそもMac miniで動かせるLLMってどんなのがあるのか、一回調べてこの選択が妥当なのかを検証しておきたい」と思ったわけです。

(一応、メモリ使用に関する計算もAIがしてくれているはずなので動くとは思うんですが、それは次回、実機で検証ですね!)

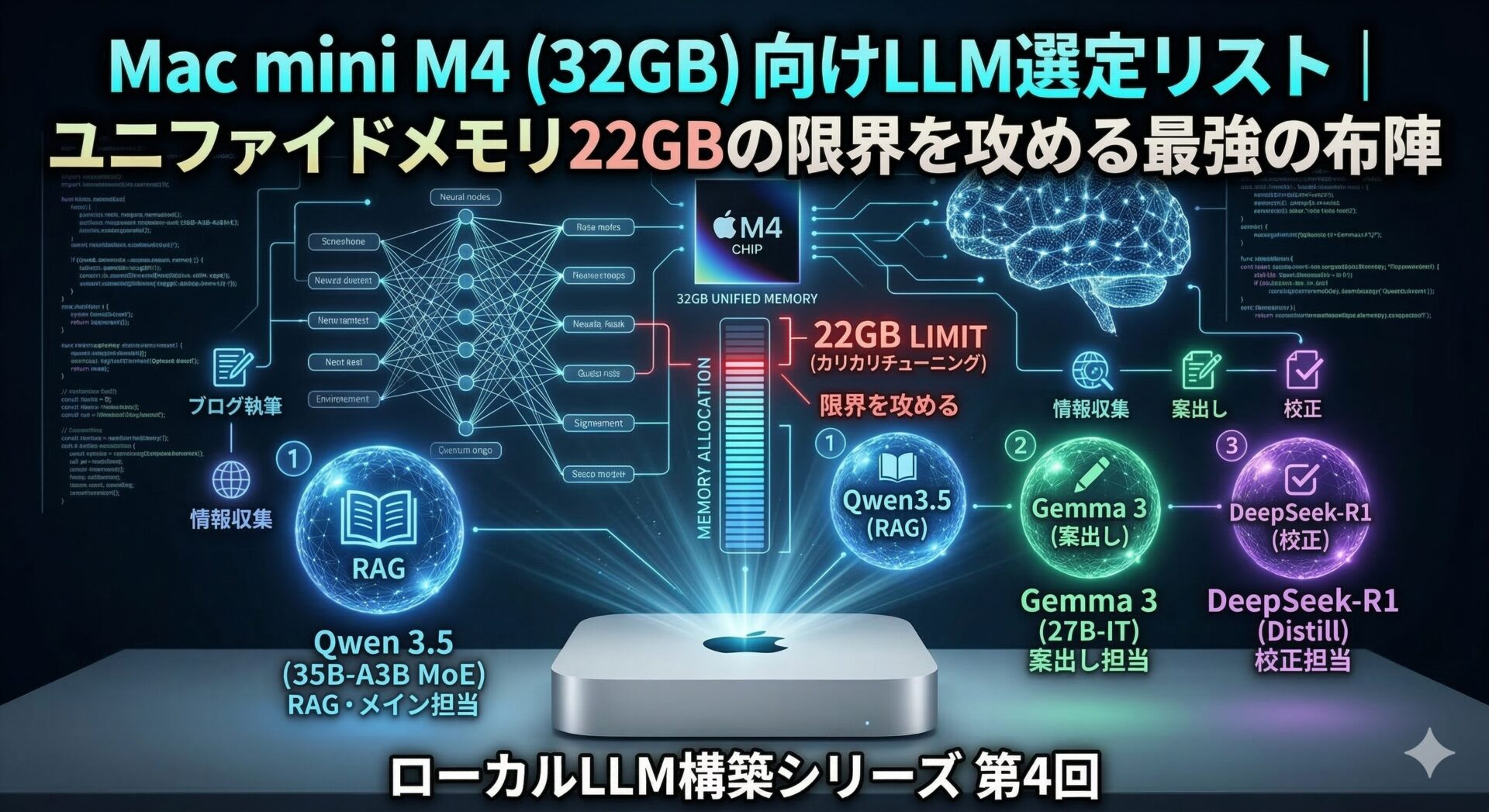

というわけで急遽予定を変更。今回は、AIが検討してくれたモデル、そして惜しくも「選外(不採用)」になったモデルの強みと弱みも含めて徹底的に解説し、私の用途と照らし合わせた「Mac mini M4 (32GB) 向けLLM選定マスターリスト(ADR)」として大公開します!

■ この記事でわかること

- Mac mini M4 (32GB) で実用的に動くLLMの限界サイズ(実質22GBの壁)

- ブログ執筆・情報収集に特化した「最強のローカルLLM」3選とその選定理由

- スマホからの軽快なラリー(案出し)を実現するためのモデル選びの罠

- 優秀なスペックを持ちながら「不採用」となったモデルたちのリアルな理由

【連載:M4 Mac miniで最強ローカルLLM環境を作る!】

- [第1回:Mac miniでローカルLLM!M4/32GBを選んだ理由と構築の準備]

- [第2回:【評価9.8】AIに構築を丸投げする神プロンプト活用術]

- [第3回:AIがOllama・OrbStackを捨てた?「ネイティブ + uv」最強構成の理由]

- 第4回:Mac mini M4 (32GB) 向けLLM選定リスト|ユニファイドメモリ22GBの限界を攻める最強の布陣(←今ココ)

- [第5回:(予定)いざ実践!到着したM4 Mac miniにローカルLLMをぶち込む]

結論:Mac mini M4 (32GB) 向けLLM選定マスターリスト

今回調べてみて分かった最大の衝撃は、Mac mini M4の32GBモデルにおいて、macOSのシステム専有分などを差し引き、LLMの推論用に確保できるユニファイドメモリの実質的な限界値は「約22.0GB」だということです。

ここを超えるとSSDへの強烈なスワップ(メモリ退避)が発生し、生成速度が劇的に低下します。

この限られた「メモリバジェット(予算)」をどう配分するか。AIが私に提案してきた、現時点での最適解を含む全モデルの比較表がこちらです。

■ LLM選定マスターリスト(Mac mini M4 32GB向け ADR)

※表を横にスクロールしてご覧ください。

※表内の「4-bit VRAM」は、Macのユニファイドメモリのうち、LLM(GPU)用に割り当てる実質的な消費メモリ容量を指しています。

| モデル名 (アーキテクチャ) | サイズ / 4-bit VRAM | 特長と強み (メリット) | 弱み / 懸念点 (デメリット) | 採用 / 不採用の理由 (ADR) |

| 【採用】 Qwen3.5-35B-A3B | 35B (MoE) 約 19.5 GB | 長文読解(16k)の圧倒的精度。MoEによるM4上での爆速推論。 | MoE特有の瞬間的なメモリ帯域のスパイクがある。 | 【RAG・メイン担当】 ブログ過去記事の読み込みとレスポンス速度のバランスが全モデル中で最高のため。 |

| 【採用】 Gemma 3 27B-IT | 27B (Dense) 約 16.0 GB | 日本語の極めて自然な表現力。クリエイティブな案出し能力。 | 論理的な厳密さ(数学や推論)では特化型モデルに一歩譲る。 | 【執筆・案出し担当】 ブログの構成や見出しを「人間らしく、魅力的に書かせる」用途で最適解のため。 |

| 【採用】 DeepSeek-R1-Distill-Qwen-32B | 32B (Dense) 約 18.5 GB | 複雑な論理破綻を見抜く最高峰の推論力。思考プロセスの可視化。 | 長文コンテキストを積むと推論速度がやや落ちる。 | 【推論・校正担当】 Gemmaの文章を論理的にチェックさせる校正役として、VRAM限界まで脳の容積を使えるため。 |

| 【不採用】 GPT-OSS Swallow 20B | 20B (RL) 約 12.5 GB | 純国産ベースの極めて優秀な日本語能力と深い推論力。 | 思考トークン生成による回答開始までの待機時間(TTFTの遅延)。 | 【見送り (最強のサブ)】 優秀だがM4のVRAMを約10GB余らせてしまう点と、iPhoneからの軽快なラリーには初速の遅さがネックになるため。 |

| 【不採用】 Command R | 35B (Dense) 約 20.0 GB | 外部ツール呼び出しとRAG(文書参照)に特化。 | 最新のQwen3.5等に比べると、日本語の流暢さで劣る。 | 【見送り】 VRAMには収まるが、ブログ執筆という用途においては日本語の表現力不足がボトルネックになるため。 |

| 【不採用】 Phi-4 | 14B (Dense) 約 8.5 GB | 14Bクラスとしては異常なほどの推論力の高さ。 | 長大なコンテキスト(16k)での情報の取りこぼし。 | 【コンテキスト耐性不足】 短い質問には強いが、過去記事を丸ごと読み込ませる今回の用途には不向き。 |

| 【不採用】 Mistral Nemo | 12B (Dense) 約 7.5 GB | 非常に軽量で、どんな環境でもサクサク動く。 | 30Bクラスと比較すると複雑な指示への追従性が低い。 | 【スペックを持て余す】 M4 (32GB) のポテンシャルがあればもっと巨大で賢いモデルを動かせるため、あえて選ぶ理由がない。 |

| 【不採用】 Llama 3.1 8B | 8B (Dense) 約 5.5 GB | モバイルでも動くほどの軽さと速さ。 | ブログの構成案など、複雑なタスクにおける論理力の限界。 | 【論理力不足】 回答が浅くなりがちで、あなたの執筆アシスタントとしては力不足。 |

| 【不採用】 Qwen 2.5 32B | 32B (Dense) 約 19.0 GB | 優れた日本語能力とコーディング能力。 | 最新のQwen3.5 (MoE) と比較すると速度も精度も劣る。 | 【旧世代】 完全に上位互換となる後継機が存在するため。 |

| 【不採用】 Mixtral 8x7B | 47B (MoE) 約 26.0 GB | MoEによる高速推論と高い総合力。 | ウェイト全体で約26GBを消費する。 | 【VRAMバジェット超過】 上限22.0GBのルールを突破し、OSのメモリを侵食してシステムがフリーズするため除外。 |

| 【不採用】 Llama 3.3 70B | 70B (Dense) 約 42.0 GB | オープンモデル最強の絶対的知能。 | 4-bit量子化でも約42GBのVRAMを要求する。 | 【物理的限界 (OOM)】 Mac mini 32GBでは起動すら不可能なため、即時除外。 |

| 【不採用】 GPT-OSS 120B | 120B (RL) 約 65.0 GB以上 | 圧倒的な推論力と知識量。 | 要求VRAMが物理メモリを遥かに超える。 | 【物理的限界 (OOM)】 Llama 3.3 70Bと同様、ハードウェア要件を満たさないため即時除外。 |

これらはAIモデルの「脳の構造(アーキテクチャ)」の違いです。ここを知っておくと、なぜそのモデルが速いのか、遅いのかが腑に落ちます!

- Dense(密なモデル)

従来の標準的な構造です。入力に対して「脳のすべての細胞(パラメータ)」を一斉に起動してフルパワーで考えます。挙動が安定しており論理力も高いですが、モデルサイズが大きくなると計算量が膨大になり、推論速度が落ちます。(例:Gemma 3、Llama 3.1 など) - MoE(混合専門家:Mixture of Experts)

脳の中に「文章担当」「コード担当」など複数の専門家チームがおり、質問に合わせて必要な専門家だけを瞬時に呼び出して回答する最新構造です。脳全体をフル稼働させないため、巨大なモデルでもM4チップ上で爆速で動くのが最大の強みです。(例:Qwen 3.5、Mixtral など) - RL(強化学習 / 推論特化型)

いきなり回答を出さず、内部で「うーん、前提条件はこうで、だから結論は…」と長々と独り言(思考トークン)を生成して論理を組み立てる構造です。複雑な論理破綻を見抜く天才ですが、その分、最初の言葉が出てくるまで(初速)に待機時間が発生します。(例:DeepSeek-R1、GPT-OSS Swallow など)

結論から言うと、巨大なAIの脳みそを、Macのメモリに収まるように「超圧縮」する魔法の技術です。

- なぜ必要なの?(そのままじゃ動かないの?)

AIのモデルは本来、非常に細かい小数点(16-bitなど)のデータで構成されています。

例えば、今回採用した「Qwen3.5-35B」を無圧縮のまま動かそうとすると、約70GB以上ものメモリが必要になり、32GBのMac miniでは起動すらできません。 - 量子化(Quantization)とは?

この細かすぎる小数点データを、AIの賢さが極端に落ちないギリギリのラインで「四捨五入(丸め込み)」してデータ量を削る技術です。

「超高画質なRAW写真を、パッと見は変わらないスマホ用のJPEG画像に圧縮する」ようなイメージです。 - 4-bit量子化の威力

現在のローカルLLM界隈で主流なのが、データを約4分の1に圧縮する「4-bit量子化」です。

この魔法のおかげで、本来なら絶対に手の届かない35Bクラスの巨大で賢いモデルを、「約19.5GB」というMac miniの22GBバジェット内にすっぽり収めて、爆速で動かせるのです!

つまり、「量子化(GGUFファイル等)」があるからこそ、私たちはM4 Mac mini 32GBという一般向けのPCで、最先端のAIを自宅で飼うことができるわけです。

独自考察:なぜ「32GBモデル」でこの3つが選ばれたのか?

今回、改めて各モデルのスペックやコミュニティの評価を調べてみて、AIが単に「動くから」という理由で選んだわけではないことがわかってきました。

ブログ執筆という過酷なワークフローにおいて、「速度」「表現力」「論理」の三要素をユニファイドメモリ22GBの枠内に収めるための、非常に戦略的なチョイスだったんです。

1. ユニファイドメモリ22GBを使い切る「攻めのリソース配分」

32GBのMac miniをフル活用するには、表にあるMistral NemoやLlama 3.1 8Bのような軽量モデルではせっかくのM4チップのスペックを持て余してしまいます。

一方で、40GB以上のメモリを要求するLlama 3.3 70BやGPT-OSS 120Bクラスは物理的に門前払い。

AIの判断は「27B〜35B前後のモデルを量子化し、16GB〜20GB前後のメモリ消費に抑えて動かす」というものでした。これがM4 32GBモデルにおける最も「賢い」使い方だったわけです。

2. iPhone連携まで見据えた「初速(TTFT)」という評価軸

私がAIに伝えていた要望の一つが、「外出先からiPhoneを使って自宅のMac miniにアクセスし、AIと壁打ち(ラリー)をしながらアイデアを練りたい」というものでした。

この時、回答が始まるまでの「待ち時間(TTFT:Time To First Token)」はモチベーションをダイレクトに左右します。

純国産ベースのGPT-OSS Swallow 20Bが非常に優秀でありながら次点に沈んだのは、回答開始前の「思考トークン」生成による待機時間が、スマホでの軽快なラリーを阻害すると判断されたためです。

3. 「過去記事の読み込み」に耐えうるコンテキスト処理能力

新しい記事を書く際、過去の自分の記事スタイルや、ネット上の最新情報を大量に読み込ませる「RAG(検索拡張生成)」の精度が命になります。Phi-4は推論力は高いものの、長文を読み込ませた際の情報の取りこぼしがネックでした。

ここを完璧にこなしたのが、MoEアーキテクチャで高速処理を実現するQwen 3.5です。

ブログ執筆を自動化する「三位一体」ワークフロー

AIが提案してくれた3つの採用モデル。これらは独立して使うのではなく、以下のように「連携」させることで真価を発揮します。

ブログの過去記事やネット上の参考資料など、大量のテキストデータを16kの長大なコンテキストに叩き込みます。Qwenはここから一瞬で文脈を理解し、記事の「骨子」を抽出してくれます。

Qwenが出した骨子を元に、iPhoneからGemma 3と会話のラリーを行い、見出しや表現のアイデアを出させます。Gemma 3の「人間らしく、魅力的に書かせる」能力は随一で、検索ユーザーの心を動かす情緒的な文章を生成してくれます。

最後に、Gemmaが書いた下書きをDeepSeek-R1に渡し、「論理破綻はないか」「主張に矛盾はないか」を厳格にチェックさせます。推論プロセスを可視化してくれるため、AIが「なぜその修正を提案したのか」が手に取るようにわかります。

運用環境(クラウド vs ローカル)メリット・デメリット比較

今回構築するローカル環境と、クラウド型のChatGPTやClaudeを利用した場合の比較をまとめました。

| 比較項目 | メリット (M4 32GBローカルの強み) | デメリット (M4 32GBの弱み) |

| コスト・制限 | API料金や月額課金を気にせず、30Bクラスの高性能モデルで文字数無制限のラリーが24時間可能。 | 電気代は自己負担。また、モデルのセットアップや管理は自力で行う必要がある。 |

| メモリの制約 | M4チップと広帯域ユニファイドメモリの恩恵で、30Bクラスでもスマホアプリ並みの爆速レスポンスが出る。 | メモリ上限(約22GB)の都合上、複数モデルの同時起動は困難。用途ごとにモデルを切り替える手間が発生する。 |

| 機密性 | 未公開のブログ記事案や個人的なメモを読み込ませても、外部サーバーにデータが一切送信されない。 | 70B以上の「超巨大モデル」が持つ圧倒的な絶対知能には、物理的に手が届かない。 |

よくある質問(FAQ)

- 32GBモデルでLLMを動かすと、他のアプリが重くなりませんか?

-

はい、重くなる可能性が高いです。

というのも、今回の選定は「私がこのMac miniをローカルLLM専用サーバーとして構築する」という前提があるため、22GBの限界ギリギリまでメモリを攻めた「かなりカリカリなモデル選択」をしています。

もし、このMacでブラウザのタブを大量に開き、動画編集やデザイン作業と並行しながらLLMを動かす場合、OSの強烈なスワップ(SSDへの一時退避)が発生し、Mac全体の動作がもたつくことがあります。

普段の作業用PCと兼用する場合は、モデルサイズを下げるなどの注意が必要です。 - 不採用になったモデル(Swallowなど)はもう使えないんですか?

-

いいえ、いつでも自由に使えます!

今回構築する「

llama.cppベース(ネイティブ環境)」の最大の利点は、「好きなモデル(GGUFファイル)をネットから拾ってきて、フォルダに放り込むだけで自由に切り替えられる」ことです。

とりあえずAIおすすめのGemmaを入れておいて、後から最強のサブであるGPT-OSS Swallow 20Bを追加して試す、といった柔軟な運用が可能です。 - Qwen 3.5の弱みにある「MoEによる瞬間的なメモリ帯域のスパイク」とは何ですか?

-

MoE(混合専門家)モデルは、推論の瞬間に必要な「専門家(ニューラルネットワークの一部)」だけを呼び出すため高速ですが、その切り替え時に瞬間的に大きなメモリ転送帯域を要求します。

M4チップは帯域が広いためこのスパイクを吸収できますが、メモリ帯域の狭い旧世代のMacだと一瞬カクつく原因になります。

まとめ:M4 32GBは「AIライター」にとっての完成形だ

結論として、Mac mini M4 (32GB) は、「現実的な予算で最高峰の日本語AI環境を手に入れる」ためのスイートスポットです。

Llama 3.3 70Bのような怪物を動かせないのは少し悔しいですが、AIが算出してくれた予算の限界(ユニファイドメモリ22GB)を理解し、Qwen 3.5、Gemma 3、DeepSeek-R1を適材適所で使い分ければ、商用レベルのブログ記事執筆には十分すぎるほどの知能を発揮してくれます。

また、llama.cppのおかげで、気分に合わせて好きなモデルを自由に追加できる拡張性の高さも最高です。

いやあ、AIが提示してくれた構成を自分なりに調べて検証してみて、本当に良かったです。「なぜこのモデルなのか」が腑に落ちました。

さあ、環境の検証もモデルの検証も完璧です。

次回(第5回)こそはいよいよ、到着したピカピカのM4 Mac miniに、これらのモデルを実際に「ブチ込む」実践編をお届けします!果たして計算通り動くのか!? お楽しみに!

コメント