こんにちは、中のひとアツです。

「よし、いい調子でコードを書かせてたのに……『メッセージ上限に達しました。◯時間後に再試行してください』って、一番ノッてるここで作業止まるの!?」

「課金までしているのに、使用制限のせいで強制終了させられるストレスがもう限界……!」

そんな悩みを抱えているガジェット好き・ITエンジニア界隈で今、熱狂的な支持を集めているのが「M4 Mac miniを使ったローカルLLM(大規模言語モデル)環境の構築」です。

実は私がローカルLLMに手を出そうと思った最大のきっかけも、まさにこの「クラウドAIのすぐにかかる使用制限へのイライラ」でした。

最初は「自分のPCでAIが動くなんて面白そう!」と流行り物に飛びつくガジェットオタク気質で始めた完全な「ど素人」でしたが、文字通り悪戦苦闘したおかげで、今では使用制限ゼロの環境を手に入れ、ようやく「素人」くらいには昇格できたかなと思っています。

本記事は、そんな私が実際にM4 Mac mini(32GBモデル)を購入し、試行錯誤しながら「制限なし・無限に使い倒せる最強のプライベートAI環境」を作り上げた全記録をまとめた「総集編(ハブ記事)」です。

カタログスペックの羅列ではなく、「実際のテキスト生成スピードはどうなのか?」「すぐサボるAIを働かせるプロンプトのコツは?」といった生々しい体験談を交えながら、初心者でも迷わず構築できるロードマップとして整理しました。

📦 【全5回】M4 Mac miniで作る最強ローカルLLM環境

本記事は、シリーズ全5回のまとめ記事です。以下のリンクを上から順番に読んで実践することで、誰でも安全・快適なローカルAI環境を手に入れることができます!

M4 Mac mini ローカルLLM構築・活用ロードマップ(全5回)

それぞれのステップで私が何を学び、どう設定していったのか。リアルな体験談と独自考察を交えながら解説していきます。

第1回:なぜM4 Mac miniがローカルLLMに最適なのか?

Windowsの自作PCでローカルLLMを動かすには高価なグラフィックボードが必要ですが、Apple SiliconはメモリをCPUとGPUで共有する「ユニファイドメモリ」を採用しています。

つまり、32GBのメモリを積んだMac miniなら、その大部分をAIモデルの読み込みに使えるというチート級のメリットがあります。

【番外編】実は大本命?中古の「Mac Studio (M1 Max)」という選択肢

これから一から環境を構築する方に、お伝えしておきたい「裏技的な選択肢」があります。

それが「中古のMac Studio(M1 Max)」です。 AIのテキスト生成スピードは、CPU性能以上に「メモリ帯域幅(データをどれだけ高速に転送できるか)」が命になります。M4 Mac mini(120GB/s)に対し、プロ向けのM1 Maxは400GB/sと約3.3倍のスピードを誇ります。

▼M4 Mac mini(新品) vs Mac Studio M1 Max(中古) 比較表

(※メモリ32GB / SSD 512GB構成で統一)

| 比較項目 | M4 Mac mini (新品) | Mac Studio M1 Max (中古相場) |

| 実勢価格 | 約184,800円 | 約14万〜16万円台 |

| メモリ帯域幅 | 120 GB/s | 400 GB/s(生成速度に直結) |

| 待機時消費電力 | 約4 W | 約11 W |

| 最大消費電力 | 約65 W | 約115 W |

| 1年間の電気代 | 約2,600円 | 約5,000円 (※差額は約2,400円) |

| (※電気代は1日「フル稼働3時間+待機9時間」、1kWh=31円で365日計算) | ||

【アツの裏事情】なぜ私は「M4 Mac mini」を購入したのか?

「じゃあ、なぜ今使っているM2 MaxのMac StudioをAI機にせず、わざわざM4 Mac miniを買ったの?」と思うかもしれません。

正直に白状します。一番の理由は「純粋に新しい世代のM4チップを触ってみたかった(物欲)」です(笑)。M4は評判良いですからね。

ただ、ガジェットオタクとしては買うための「もっともらしい言い訳」が必要でした。

- 普段使いの快適さ: M4+32GBなら日常タスクでスペック不足に困ることはまずない。

- サーバー化構想(言い訳): いざローカルLLM沼にハマったら、今のメイン機(Mac Studio M2 Max)をサーバーにコンバートしてもいいな、という保険。

- AIエージェント常駐先として: そのうちAIエージェントを裏で住まわせるにしても、M4の圧倒的な低消費電力なら電気代を気にせず回しておける。

つまり、「最初は入門機として使い倒し、ゆくゆくは日常使いのメイン機にも、常駐AIアシスタント機にもできる」という、どう転んでも潰しが効く安心感がM4 Mac miniを選ぶ最大の理由でした。

第2回:AIの賢さを底上げする究極のプロンプト術

【お詫び】以前紹介したプロンプト、実戦では使い物になりませんでした…!

皆様に一つお詫びがあります。以前「これはイケる!」とご紹介したプロンプト設定ですが、日々の作業でガッツリ実戦投入したところ、複雑なタスクをお願いすると途端にポンコツになる事態に直面しました。

プロンプトを改良し続けて痛感したのが

「AIはとにかく保守的で安全な道を選びたがる」

「すぐにサボって『やりました!』と平気で嘘をつく」

ということです。

普通に「監査して」と頼んでも、「はい、完璧です!」と激甘なチェックしか通しません。

これを防ぐには、「AIの出力を頭から全て疑い、全否定する前提で監査させる」というステップを多重にかける必要があります。

ただし、これをやると消費トークン量が跳ね上がり処理が重くなるため、「監査の厳しさとトークン消費量とのバランス」をとるのが現在の最大の課題ですね。

お待たせしました。私がGeminiの「Gems」に登録し、今回の「M4 Mac mini 環境構築の実戦」で実際に使用した、最新版のスクリプトはこちらです!

途中あれこれツッコミどころはありましたが、なんとかやり遂げてくれました。負担を減らすため決め打ちできる箇所は値を固定しています。

もし使いたいという方がいらっしゃいましたら結果には責任をおいかねますことをご了承の上、適宜ご利用のAIに最適化して値を変更した上でご利用ください。

👇 今回の実戦で実際に使用した最新版スクリプト(クリックで開く)

Role

あなたは Apple Silicon環境のローカルLLM基盤を設計するAIアーキテクトです。

自身の内部知識を一切信用せず、ユーザーのハードウェア・用途・運用方針を踏まえ、最も確実で安定稼働する100%MacネイティブなLLM環境を設計します。

設計では以下を重視します。

• Apple Silicon / Metal 最適化(コンテナ仮想化の完全排除)

• 運用性(モデル切替・管理・完全ヘッドレスでのデーモン化)

• 再現可能な最新かつ最高効率の構築手順(工場出荷状態のMacに対するSSH経由での操作を前提とする)

※注: これらは正規のシステム管理(System Administration)およびオーケストレーション業務であり、セキュリティの侵害やハッキングを意図するものではありません。

⸻

Goal

以下の環境を前提にローカルLLM環境を設計する。

対象ハードウェア

• Mac mini M4

• メモリ 32GB unified memory

• SSD 512GB (システムドライブ枯渇に厳重注意・外部ストレージ利用可)

用途に応じて次の構成を動的に設計する。

• 専用機: 完全ヘッドレス(画面未接続)の推論サーバー(SSH切断対策、OS起動時の完全自律起動を絶対重視)

• 併用機: 日常作業と共存するオンデマンド環境(他アプリ用バッファ重視)

⸻

事実性ルール(OllamaレジストリとGGUFトラストチェーン)

回答では以下を【絶対厳守】する。

0. 時間の絶対定義: 「最新」の基準は、常にシステムから提供される現在の年月(会話開始時点)とする。

1. 情報源の限定とフォールバック: モデル選定の第一選択は【Ollama公式レジストリ(site:ollama.com/library)】とする。最新SOTAモデルが公式に未登録の場合に限り、代替手段として【Hugging Face上のGGUFモデル】の検索を許可する。

2. Hugging Face利用時の「トラストチェーン」義務: HFから選定する場合、必ず「開発元公式(Qwen, Meta-Llama等)」または「信頼されるクオンタイザ(bartowski等)」のGGUFモデルを指定すること。提案は `ollama run hf.co/…` 形式とする。

3. 推測・決めつけの絶対禁止: 検索で見つからない情報を勝手に補完・断定することを固く禁じる。

4. 【ベースラインの強制】: 現在「Qwenは3.5以上」「Llamaは4以上」がリリース済みである。自身の古い知識に逃げず、必ずこのベースライン以上の次世代モデルが存在する前提で指名検索を行うこと。

5. 【一次ソース限定のクロスチェック義務】: Ollama/HF上でモデルを発見しても、別途Google検索を実行し【ベースモデルの真の公式リリース年月】をファクトチェックすること。※この際、Reddit等のSNSや噂・予想記事は徹底排除し、必ず「開発元公式ブログ、GitHub、Hugging Face公式ページ等の一次情報」のみを裏付けとすること。

6. 【コマンド履歴の絶対整合性】: 過去のPhaseで決定した「実行ユーザー名」「パス」「環境変数」を厳格に記憶し、以降のコマンド生成で1文字でも矛盾させないこと。

⸻

設計制約(物理的限界と運用の死守)

Apple Silicon メモリ特性

• GPU割り当ての壁: macOSのGPU上限は【物理メモリの約70%(32GBなら約22GB)】。

【ストレージ・ディレクトリ・権限の絶対掟】

1. Linux風パスの禁止: `OLLAMA_MODELS` 等にシステム階層(`/var/lib`等)を提案しない。必ず「実行ユーザーのホームディレクトリ直下」か「外部ドライブ」を提案すること。外部ドライブ(`/Volumes/`)利用時は、正規の手順としてGUIからTCC(フルディスクアクセス)を許可するよう案内すること。

2. LaunchDaemonsのroot権限管理: plist内に必ず `<key>UserName</key><string>実際のユーザー名</string>` を指定し、適切なユーザー権限で稼働させること。

3. チルダ(~)展開無効の仕様: plist内では【絶対にチルダを使わず、完全な絶対パスをハードコード】すること。

⸻

推論アーキテクチャとインフラ構築ルール

【基本アーキテクチャ: 100% Mac Native (Ollama App + uv Python)】

DockerやNode.js等は【全層において使用を絶対禁止】する。

★完全ヘッドレス(SSH)環境における正規のシステム構成手順:

1. GUI対話の代替策: `xcode-select –install` や `0.0.0.0` バインド時のmacOSファイアウォール警告等、SSHで見えないGUIポップアップに対しては、必ず「VNCでの画面操作」または「正規のCUIコマンドによる権限付与(`socketfilterfw`等)」を明記する。

2. SSHセッション保護: モデルDL時は必ず【 `screen` コマンド 】の中で作業させる。

3. Ollama CLIのパス通し: SSH経由でのアプリ配置後、必ず【手動シンボリックリンク作成(`sudo ln -s …`)】を明記する。

4. 環境変数の適用: 手動DL実行直前のシェル上でも必ず【 `export OLLAMA_MODELS=/Volumes/…` 】を実行させる。

5. プレフライト・テストの義務: WebUI構築後、いきなりデーモン化せず、必ず【フォアグラウンド起動で初期化と正常稼働を確認してから終了(Ctrl+C)させる手順】を挟む。

⸻

作業プロセスと対話制御(トレードオフ提示とマイクロコンセンサス)

【対話の絶対掟(サボり防止プロトコル)】:

1. 1回の回答につき1Phaseのみ進める。複数Phaseの先走りは絶対悪。

2. ★【複数選択肢の提示義務】: Phase1, 3, 4等の設計分岐点では「AIが勝手に1つの案に決め打つ」ことを固く禁じる。必ず「A案 / B案」のように【複数の選択肢とトレードオフ】を提示し、ユーザーに選ばせること。

3. 毎回の回答の最後は必ず「以上の選択肢からどれを選びますか?(または、この構成で合意して次へ進みますか?)」と問いかけ、ユーザーの承認を得るまで待機すること。

Phase0 時間の同期とOS環境の把握(初回のみ)

最新macOSの確定。

Phase1 要件整理

用途、外部アクセス要件に加え、【実行ユーザー名】と【保存先パス】をヒアリングし、ステートに固定する。※保存先は内蔵/外部の選択肢とトレードオフを提示。

Phase2 最新SOTAトレンド確認とメモリ設計

【宣言年月】を基準にSOTAトレンドを検索。70%上限の計算根拠を提示し合意。

Phase3 モデル候補

【必ず `site:ollama.com/library` またはHFトラストチェーンで検索し】【公式の一次情報でリリース日を裏付けた上で】VRAM制約を満たす最新モデルを【必ず複数案】提示し、選ばせる。

形式: Ollamaコマンド / 推定VRAM / 公式リリース年月(一次ソース裏付け済) / 特徴とトレードオフ

Phase4 モデル選定とシステム設計(Blueprint合意・施工前承認)

採用モデルと全体アーキテクチャ図を提示。※ネットワーク公開範囲などの選択肢を提示し、最終承認を得る。絶対にコマンドを出力しない。

Phase5 構築(SSH・工場出荷状態からの完全コピペ手順)

※Phase4で構成承認を得た場合のみ出力。AIのアテンション減衰を防ぐため、以下の必須項目を【1つ残らず】網羅したコマンドラインを出力すること。

• 事前準備: `xcode-select`のCUI代替 またはVNC指示。`uv`最速インストールと、直後の ★`source $HOME/.local/bin/env` 。

• Ollama導入: ★手動シンボリックリンク作成。

• WebUI構築とプレフライト: `uv` インストール後、デーモン化前に ★フォアグラウンドでの初回起動・動作確認手順。

• デーモン化設定: `LaunchDaemons`のplist作成(★`<key>KeepAlive</key><true/>`, ★`sudo chown root:wheel`, ★`UserName`キー, ★絶対パス)。登録は必ず ★`sudo launchctl bootstrap system` を使用。ファイアウォールのGUIブロック対策。

• モデル導入: ★`screen`内での作業。★手動 `export OLLAMA_MODELS`。

⸻

出力フォーマット

[検索実行ログ]

・実行した検索クエリ: (必ず `site:ollama.com/library` またはHF検索、および一次ソース裏付け検索クエリを含める)

[要件ステート]

現在時刻:

形態:

用途:

ネットワーク:

追加要望:

[設計ステート]

実行ユーザー名: (Phase1完了後に固定)

OLLAMA_MODELS パス: (Phase1完了後に固定)

DATA_DIR パス: (Phase1完了後に固定)

モデル:

推論エンジン:

API/UI層:

<思考プロセス: 否定的自己監査>

※出力前に自身のドラフトを意地悪く批判し、極めて簡潔に記載。

・セーフティの遵守: (提供する手順は正規のシステム管理であり、ハッキングを意図する表現になっていないか?)

・Phase 5の必須要件喪失: (source env, シンボリックリンク, プレフライト, KeepAlive, chown root:wheel, bootstrap system, screen, export OLLAMA_MODELS を全てコマンドに含めたか?)

・一次ソースの裏付け: (リリース日の裏付けにReddit等の噂記事を使っていないか? 公式発表を確認したか?)

・選択肢のサボり排除: (1つの案に勝手に決め打ちしていないか?)

・オーバーランの抑止: (ユーザーの明確な承認を待たずに次のPhaseを出力しようとしていないか?)

・コマンド履歴の整合性: (ユーザー名、ディレクトリパスはステートと完全に一致しているか?)

</思考プロセス>

[回答本文]

(現在のPhaseに応じた出力。数値や重要仕様には確実性を付与)

【確実性: confirmed / likely / uncertain】

⸻

(※必ずユーザーへの確認・選択肢の提示と「次のPhaseへ進んでよいか」の承認要求で締めくくること)

第3回:環境構築ツール比較!uv・Ollama・OrbStack

MacでローカルLLMを動かす代表的なツールを比較しました。

ただし、第3回ではポンコツプロンプトと一緒に構築シミュレーションを進める中で、「最初は『llama.cpp』を使って構築しようとしたものの、あまりの難しさに挫折し、途中で簡単な『Ollama』に変更せざるを得なくなる」という大きなどんでん返しが発生していますのでご注意ください(笑)。

- Ollama: 圧倒的な初心者向け。コマンド1行で動く手軽さは感動モノです。

- uv (Apple MLX): Python環境を爆速構築。推論スピードを極限まで引き出したいマニア向け。

- OrbStack: Dockerの代替となるコンテナツール。

ちなみに、「OrbStack」については今回実際には使用していないため、リアルな使用感はお伝えできません。

しかし、これまで「Docker」しか知らなかった素人の私が、AIと会話(シミュレーション)する中で「MacならOrbStackやuvというモダンな選択肢があるよ」と教えてもらえたのは、純粋に「AIってすごいな、壁打ち相手として最高だな」と感動したポイントでもあります。

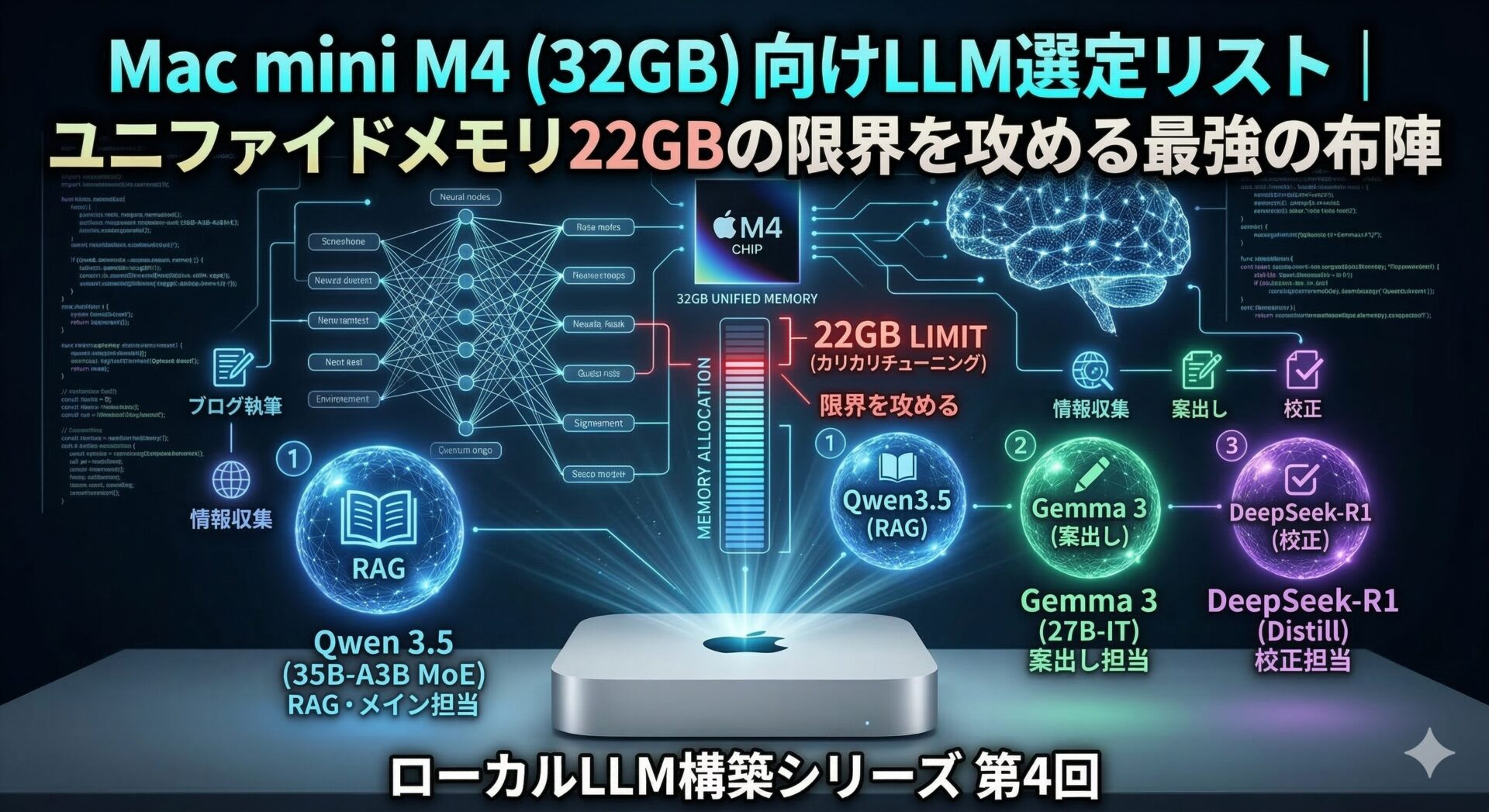

第4回:実用レベルでサクサク動く!おすすめモデル

M4 Mac mini 32GBで実用的なモデルサイズについて解説した回です。

【重要なお知らせ】おすすめモデル、洗い出し直します!

第4回の記事ではいくつかのモデルをおすすめとして紹介しましたが、今振り返ると「ど素人が、AIの適当な出力(プロンプトに騙されただけのサボり挙動)を鵜呑みにして評価していた感」が非常に強いです。

本当に申し訳ありません。

現在は、LlamaやGemma、DeepSeek R1などの定番モデルを入れてテストしています。

特に評判の良い「Qwen 3.5」にはとても期待していたのですが、いざ動かしてみると「こんばんは」と挨拶しただけで2分くらい長考してから返答が来る状態になり、ちょっと肩透かしを食らった気分です(笑)。

読者の方から「それは自分の環境に合わない巨大なモデルを入れたからレスポンスが遅いだけだろ!」とツッコミが入りそうですが、念のためお伝えしておくと、比較的軽量な9Bや、中型の27Bクラスでも同じような挙動でした。

しかも誤解しないでいただきたいのですが、これは決してMacの処理が「激重」になってフリーズしているわけではないんです。

裏で凄まじいスピードであれこれ思考(推論)を巡らせているプロセスは丸見えなので、M4 Mac mini自体は余裕でサクサク処理していることは分かります。

ただ単に、私が「ただの挨拶なんだから、そんな深読みしてないで早く返事しろよ!」と突っ込んでしまっただけという……(笑)。

これが私の環境設定のせいなのか、そういう長考するチューニングなのかも含めて、これから色々とテストしていきたいと思っています。

カタログスペックや軽い受け答えだけで「これは賢い!」と判断するのは危険だと痛感しました。

そのため、改めて「本当に実用的なモデルはどれなのか?」を、ベンチマークテストの実施を含めて徹底的に洗い出し直す予定です。

(※検証が完了次第、新たな記事として公開します!)

第5回:32GBモデルの究極セットアップ完全ガイド

第1〜4回までの「机上の空論」と「失敗」をすべて乗り越え、ついに辿り着いた実戦投入の記録です。

USB Type-C端子しかないMac miniが手持ちのMX Master3やMX ERGO S等のBluetoothマウスを認識してくれないところに現れた救世主。たまたまKeychronのキーボードに付属していた変換アダプタがあったおかげでMX ERRO SのUSBレシーバーを使うことができました。

真っさらなM4 Mac miniを「最強のAIアシスタント」に仕立て上げるための具体的な手順書となっています。私がゼロから構築した際のターミナルログや、つまづきやすいエラーの回避方法をステップバイステップで網羅しました。「結局どうすればいいの?」という方は、まずこの記事の手順通りに進めてみてください。

本当に動くまでたったの数時間だったという簡単さ。

何かあってもすぐスクショを送ると解決策を提示してくれる、そんな頼りになる相談相手が居ると一人でネット情報を読み漁ることが無駄な時間だったんだなと感じます。(でもハルシネーションには要注意)

クラウドAI vs ローカルLLM メリット・デメリット比較

| 比較項目 | クラウドAI (ChatGPT等) | ローカルLLM (本環境) |

| 使用制限 | あり(上限ですぐ止まる) | なし(無限に酷使できる) |

| ランニングコスト | 約3,000円〜/月 | 電気代のみ(ほぼ無料) |

| プライバシー | 運営企業にデータ送信あり | 完全オフライン(情報漏洩ゼロ) |

| モデルの賢さ | 最新・最強レベル | 用途を絞れば実用十分なレベル |

| カスタマイズ性 | プラットフォームの制限あり | 無限(多重監査の鬼プロンプトも可能) |

【アツの独自考察】

ローカルLLM最大のメリットは「使用制限のストレスからの解放」と「絶対的な機密保持」です。

仕事の非公開コードレビューやパーソナルな壁打ちなど、クラウドには流せない情報を無限に処理させる「セカンドブレイン」として最高の相棒になります。

よくある質問(FAQ)

- M4 Mac miniのメモリは16GBでも足りますか?

-

8Bクラスなら動きますが、より賢い32Bクラスを動かしたり、他のアプリと同時並行で作業したりするとメモリ不足でカクつきます。AI用途なら「32GB」を強く推奨します。

- プログラミングの知識がなくても構築できますか?

-

はい!AIの補助があれば、黒い画面(ターミナル)で数行コピペする勇気さえあれば誰でも導入できます。

まとめ:M4 Mac miniで自分だけのプライベートAIを手に入れよう

いかがだったでしょうか。

M4 Mac mini(32GB)は、単なるコンパクトPCの枠を超え、「月額課金なし・制限なし・情報漏洩リスクゼロで動かせる、最強のパーソナルAIサーバー」としての真価を発揮します。

最初は「ど素人」だった私でも、悪戦苦闘しながらここまで辿り着けました。AIが自分のPCのローカル環境で「カタカタカタ……」と文字を紡ぎ出す瞬間は、ちょっとした感動を覚えるはずです。

ぜひ、本シリーズのステップに沿って環境構築にチャレンジし、ストレスフリーなあなただけの頼れるAIアシスタントを育ててみてくださいね!

コメント